Повний гайд по AI-агентах: чим відрізняються від чат-ботів, як обрати між Claude і ChatGPT, як написати промпт і запустити першого агента вже сьогодні

Чесне порівняння AI-відеомоделей: Sora, Veo чи Runway, який інструмент обрати українському контент-мейкеру в 2026

Sora 2, Veo 3 чи Runway, що насправді допоможе тобі створювати кінематографічний контент без бюджету голлівудської студії? Порівнюємо не лише картинку, а й вартість, стабільність генерації та зручність монтажу для регулярного створення відеоконтенту.

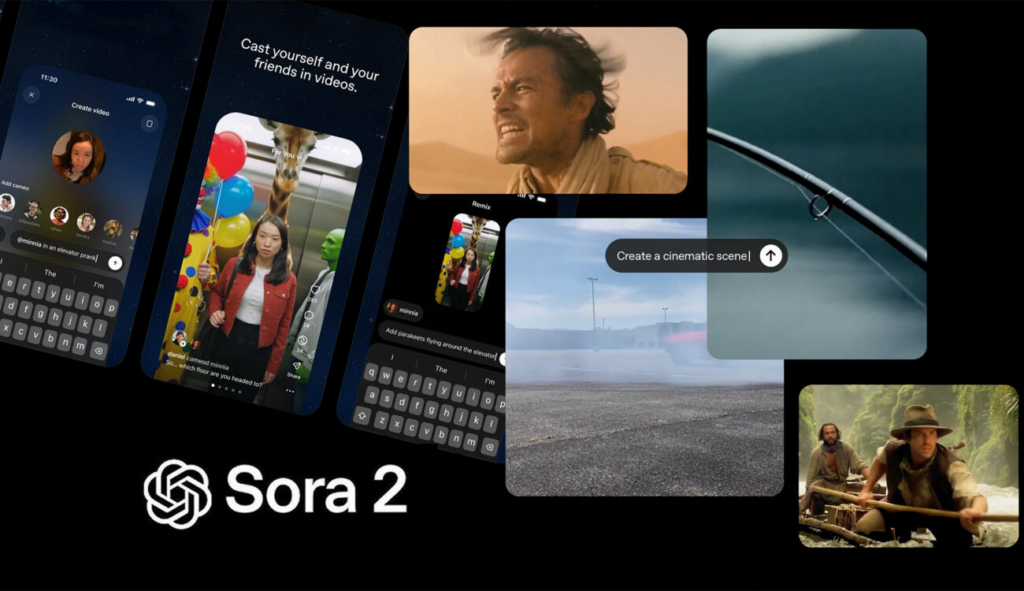

Сьогодні на ринку вже існують десятки AI-інструментів для генерації відео. Але якщо подивитися на моделі, які найчастіше обговорюють професійні креатори, то на перших позиціях стабільно залишаються Sora 2, Veo 3 і Runway — саме вони зараз задають темп у сегменті AI-відео.

Оплачувати всі платформи одночасно лише для того, щоб вони пилилися у закладках браузера за принципом «раптом знадобляться», для більшості контент-мейкерів просто невигідно. Тож яка з моделей: Sora 2, Veo 3 чи Runway — справді може стати твоєю «робочою конячкою» у 2026 році?

У цій статті розберемо, що кожна модель робить найкраще, скільки реально коштує робота з нею, де ти отримуєш більше контролю над кадром, а де — швидший результат для щоденного контенту. Окремо подивимося, який AI-відеостек сьогодні виглядає найраціональнішим саме для українського контент-мейкера.

Sora 2: чому саме ця модель досі вважається еталоном AI-відео

Коли в AI-відео говорять про максимально реалістичний результат, першим майже завжди згадують OpenAI Sora 2. Саме ця модель стала орієнтиром для ринку після того, як показала складні сцени з переконливою фізикою руху, глибиною кадру і поведінкою об’єктів, яка нагадує роботу реальної камери, а не просто анімацію.

На практиці Sora 2 сильна там, де потрібно створити відео, яке виглядає не як AI-експеримент, а як короткий фрагмент рекламного ролика або трейлера. Модель добре працює зі світлом, перспективою, рухом тканин, рідин і складною взаємодією кількох об’єктів у кадрі. Саме тому її часто називають найближчою до кінематографічного рівня серед доступних AI-відеорішень.

Що Sora 2 сьогодні вміє найкраще

Найсильніший бік Sora — здатність тримати складну сцену без різких візуальних збоїв. Якщо в prompt задати кілька елементів одночасно — наприклад, рух людини, зміну освітлення і переміщення камери — модель у більшості випадків зберігає логіку простору. До сильних сторін Sora 2 також належать:

- реалістична фізика руху;

- плавні кінематографічні переходи;

- стабільніше освітлення в багатошарових сценах;

- точніша глибина простору;

- нативний звук у нових режимах генерації.

Окрема функція, яка привернула багато уваги, — Characters. Вона дозволяє використовувати одного персонажа в кількох сценах зі збереженням зовнішності та пластики, що особливо важливо для рекламного або сюжетного контенту.

Що важливо знати перед реальною роботою із Sora 2

Попри сильний результат, Sora поки що не виглядає як найпростіший щоденний інструмент. Навіть у 2026-му OpenAI тримає Sora 2 за високим парканом підписок (Plus/Pro) або через запрошення для «обраних» творців.

Є й технічні рамки: більшість генерацій працює у межах 15 секунд (для преміум-підписки — 25 секунд). А це означає, що довший ролик доводиться збирати з кількох окремих сцен. Для українського користувача окремим питанням залишається й практична сторона: оплата, стабільний доступ і прогнозованість витрат поки що виглядають складнішими, ніж у більш відкритих платформах.

Де Sora 2 має обмеження

Попри дуже сильну картинку, Sora поки що не дає такого production-комфорту, як браузерні AI-студії. Після генерації сцену все одно часто доводиться переносити в інший редактор для монтажу, титрів, переходів і фінальної збірки.

Також модель залишається однією з найбільш юридично контрольованих. У відео додаються watermark, C2PA-метадані й додаткові механізми виявлення AI-контенту.

Для яких задач Sora 2 справді виправдана

Sora сьогодні — це скоріше інструмент для точкового wow-ефекту, ніж для щоденного масового продакшина. Sora має сенс там, де потрібен невеликий обсяг, а сильний одиничний результат:

- брендова презентація;

- короткий рекламний ролик;

- трейлер;

- візуальний концепт для клієнта;

- іміджевий контент.

Саме тому після першого знайомства з Sora багато креаторів переходять до іншого питання: яка модель дає більш практичний результат там, де контент потрібно випускати регулярно. І тут логічно перейти до Veo 3, яка зараз дуже швидко посилює свої позиції саме у вертикальному відео.

До речі, саме цей перехід від «красивих картинок» до вибудовування реальної системи роботи ми детально розбираємо на курсі «AI Video Creator». Це найкоротший шлях до розуміння того, як поєднувати різні сервіси у єдиний робочий процес, щоб створювати контент швидше та якісніше. Якщо відчуваєш, що готовий перетворити нейронки на свою повноцінну відеостудію — приєднуйся.

Veo 3.1: чому саме ця модель швидко стала фаворитом для вертикального відео

Якщо Sora 2 асоціюється передусім із кінематографічною складністю кадру, то Veo 3.1 від Google швидко зайняла іншу сильну позицію — модель, яка дуже добре розуміє логіку сучасного короткого відео для смартфона. Саме тому її особливо активно тестують ті, хто працює з Shorts, Reels і вертикальними форматами, де важлива не лише естетика, а й технічна чистота кадру.

На відміну від частини конкурентів, які інколи дають ефектний, але менш передбачуваний результат, Veo 3.1 часто поводиться як більш «слухняний» інструмент. Вона точніше тримає композицію, стабільніше виконує заданий рух камери й рідше змінює логіку сцени без причини. Саме ця передбачуваність зробила її однією з найсильніших моделей для швидкого production-контенту.

Що Veo 3.1 сьогодні вміє найкраще

Найсильніше Veo показує себе у коротких динамічних сценах, де важлива чистота руху й точне виконання візуальної логіки. До сильних сторін Veo 3.1 належать:

- стабільна генерація вертикального формату 9:16;

- якісний рух камери без різких зламів сцени;

- хороша відповідність деталям prompt;

- підтримка 1080p, 4K і до 60 fps у доступних режимах;

- нативний звук із фоновими ефектами та голосом;

можливість працювати з кількома image-reference одночасно.

Окремо варто виділити функцію Ingredients to Video: модель дозволяє використовувати до чотирьох референсних зображень, щоб краще зберігати зовнішність персонажа, стиль середовища або окремі деталі сцени. Це особливо корисно, коли потрібно отримати серію візуально пов’язаних кадрів, а не один випадковий результат.

Однією з причин, чому Veo 3.1 швидко привернула увагу креаторів, стала її передбачуваність у роботі. Якщо промпт сформульований чітко, модель частіше вже з перших генерацій дає сцену, яка зберігає потрібну композицію, атмосферу й рух без різких візуальних збоїв.

У реальній роботі це особливо відчувається тоді, коли потрібно швидко отримати кілька варіантів одного кадру, протестувати різні подачі сюжету або підготувати серію коротких сцен для подальшого монтажу. Саме тому Veo 3.1 зараз часто використовують там, де важлива не лише якість окремого кадру, а й швидкість отримання стабільного результату.

Якщо ти хочеш дізнатися, як витиснути максимум з відзнятого матеріалу за допомогою звичайного смартфона, обов’язково прочитай статтю «Найкращі техніки монтажу 2026: як зробити професійне відео на звичайному телефоні». Там розібрані фішки, які допоможуть твоєму контенту виглядати дорого навіть без професійної камери та складного обладнання.

Що важливо знати перед реальною роботою з Veo 3.1

Одна з сильних сторін Veo — інтеграція в екосистему Google. Найзручніше модель працює через Google Gemini Advanced, Vertex AI або інструменти всередині YouTube, де вже тестуються функції генерації коротких фонів і коротких AI-вставок для відео.

Базова довжина генерації зазвичай становить до 8–10 секунд, але модель підтримує Scene Extension, що дозволяє поступово добудовувати сцену без різкого розриву між фрагментами. Для швидких тестів також використовується режим Veo Fast, який помітно скорочує час очікування і зручний для A/B-перевірки ідей.

Ще один практичний плюс — Veo добре працює в тих випадках, коли потрібно швидко адаптувати одну ідею під кілька форматів. Наприклад, перевірити, як одна сцена виглядатиме у різних подачах або в іншому ритмі руху.

Де Veo 3.1 має обмеження

Попри сильний результат, Veo поки що не дає повного production-середовища. Після генерації сцени її зазвичай все одно потрібно переносити в окремий редактор для монтажу, титрів і збирання повноцінного ролика. Для довших композиційних відео кілька генерацій доводиться комбінувати вручну, а при складних багатошарових сценах модель інколи поступається Sora у глибині фізики руху.

Для яких задач Veo 3.1 справді виправдана

Veo особливо добре підходить там, де потрібно регулярно створювати якісний вертикальний контент без довгого циклу доопрацювання:

- короткі відео для соцмереж;

- рекламні вертикальні вставки;

- мобільні product-shot сцени;

- тестування creative-гіпотез;

- швидкі відеофрагменти для YouTube Shorts.

Якщо коротко, Veo 3.1 сьогодні виглядає як один із найсильніших варіантів для тих, хто хоче отримати якісну картинку, яка не втрачає чистоти навіть при перегляді на великому екрані. Після цього логічно перейти до моделі, яка часто виграє не окремим кадром, а саме зручністю повного щоденного workflow — Runway.

Runway Gen-4.5: головний хаб для щоденної роботи контент-мейкера

Якщо Sora 2 сьогодні асоціюється з максимально кінематографічною картинкою, а Veo 3.1 — із точним вертикальним відео під егідою Google, то Runway у 2026 році найчастіше сприймають як практичний центр щоденного production-процесу. Причина проста: Runway давно вийшов за межі простої кнопки «генерувати відео» і фактично перетворився на повноцінну браузерну AI-студію, де ти не просто отримуєш файл, а керуєш кожним пікселем на професійному рівні.

Для контент-мейкера це важливо не лише через кількість функцій, а й через сам підхід до роботи: одна платформа дозволяє пройти шлях від першого промпту до майже готового ролика без постійного переходу між різними сервісами. Саме тому Runway сьогодні часто обирають не для одного ефектного кадру, а як основний робочий інструмент у регулярному продакшені.

Що Runway сьогодні вміє найкраще

Найсильніша сторона Runway — це поєднання генерації та детального редагування в одному місці. Платформа дозволяє працювати не лише з текстом (text-to-video) чи зображеннями (image-to-video), а й вносити точкові зміни у вже створений матеріал через інструменти, які ще недавно асоціювалися лише з професійним монтажним софтом. До сильних сторін Runway належать:

- Multi-shot Editing для редагування серії сцен;

- Consistent Characters для стабільності персонажа між кадрами;

- Motion Brush 2.0 для керування рухом окремих зон кадру;

- Keyframes для точного контролю камери;

- Motion Tracking для роботи з рухомими об’єктами;

- повноцінне редагування на таймлайні.

Окрема перевага Gen-4.5 — можливість працювати не з одним окремим кадром, а з послідовністю сцен. Якщо потрібно, щоб персонаж залишався впізнаваним у кількох різних локаціях, Runway краще за більшість моделей зберігає зовнішність, одяг і загальну стилістику героя.

Ще одна причина популярності платформи серед монтажерів — Motion Brush 2.0. Цей інструмент дозволяє буквально виділити частину кадру (наприклад, волосся, туман або окремий предмет) і задати напрямок руху вручну. У поєднанні з ключовими кадрами це дає відчуття, ніби камера керується не алгоритмом, а людиною.

Що важливо знати перед реальною роботою з Runway

Runway працює за кредитною системою, і це одна з причин, чому платформу часто вважають зручною для планування бюджету. Базовий тариф Standard коштує приблизно 12 доларів на місяць і дає 625 кредитів. У режимі Turbo цього вистачає приблизно на 125 секунд генерації, що для щоденного тестування ідей виглядає досить практично.

Якщо потрібна максимальна якість, використовується режим Gen-4.5 Pro, де витрати вже вищі: близько 12 кредитів за секунду. Але навіть у цьому випадку система залишається передбачуваною: користувач чітко розуміє, скільки коштує кожна ітерація.

Для тих, хто працює у великому темпі, Runway пропонує Unlimited-режими. І саме це часто стає ключовою перевагою: коли у production потрібно зробити десятки варіантів однієї сцени, можливість не рахувати кожну генерацію окремо значно спрощує роботу.

Що ще посилило Runway у 2026 році

У нових версіях платформа помітно просунулась у роботі зі звуком. Runway вже підтримує генерацію діалогів, синхронізацію губ через Lip Sync і створення фонових шумів через Text to SFX, коли звук додається прямо всередині проєкту.

Це означає, що частину базового sound-design тепер можна зробити без переходу в окремий аудіоредактор. Для короткого digital-контенту це особливо корисно, бо один сервіс закриває ще один етап production-циклу.

Де Runway має обмеження

Попри статус універсального AI-комбайна, Runway поки що поступається Sora 2 у дуже складній фізиці сцени. Якщо в кадрі одночасно взаємодіють рідина, тканина, пил і кілька рухомих об’єктів, результат іноді виглядає менш природно.

Ще одна технічна особливість — базова генерація часто стартує з 1080p, а для великого екрана або рекламного показу доводиться окремо використовувати upscale.

Для яких задач Runway справді виправданий

Runway особливо добре працює там, де потрібен стабільний production-ритм:

- серійне створення Reels і Shorts;

- рекламні ролики з кількох AI-сцен;

- комбінування AI-відео з реальними футажами;

- VFX-правки (заміна фону, видалення об’єктів, додавання деталей);

- швидке прототипування для клієнта.

Якщо коротко, Runway сьогодні перемагає не одним випадковим сильним кадром, а тим, що дозволяє швидше за інші платформи довести сиру ідею до готового продукту. І саме після трьох окремих моделей виникає головне практичне питання:який AI-відеостек обрати українському контент-мейкеру.

Який AI-відеостек зараз працює найкраще для українського контент-мейкера

Після тестування кількох сильних моделей стає зрозуміло: у щоденній роботі одна платформа рідко закриває абсолютно все, але Runway сьогодні реально бере на себе до 90% щоденних задач контент-мейкера. Саме тут найзручніше швидко зібрати сцену, поправити деталі, додати текст, підчистити артефакти й довести матеріал до готового результату без постійного переходу між кількома сервісами.

Для більшості робочих сценаріїв цього вже достатньо: короткі ролики для соцмереж, рекламні вставки, серії однакових сцен, швидкі візуальні концепти для клієнта або адаптація одного сюжету в кілька форматів. Саме тому Runway часто стає базою, а інші моделі підключаються точково — тоді, коли потрібна конкретна сильна сторона, якої бракує в основному робочому процесі.

Що реально дає кожна модель у щоденній роботі

| Сценарій | Sora 2 | Veo 3.1 | Runway Gen-4.5 |

| Кінематографічний рекламний ролик | максимально сильна фізика кадру, глибина сцени, реалістичне світло | якісний короткий результат, але коротший формат | можна зібрати ролик із кількох сцен і відразу змонтувати |

| Вертикальні відео для соцмереж | сильний результат, але менш гнучкий у рутині | один із найсильніших варіантів під 9:16 | зручно доводити до фінального вигляду |

| Щоденне виробництво контенту | дорого для великого обсягу | добре для окремих шотів | найзручніше для регулярної роботи |

| Стабільність персонажа між сценами | Characters | image references | Consistent Characters |

| Нативний звук | сильний рівень | сильний рівень | уже працює, але не головна перевага |

| Редагування всередині платформи | ні | ні | так |

| Робота з кількома сценами підряд | обмежено | частково | одна з найсильніших сторін |

| Стартова ціна входу | від ~$20 | від ~$19.99 | від ~$12 |

| Найкращий сценарій використання | дорогий бренд-контент | короткий вертикальний контент | щоденний продакшн |

Чому саме комбінація АІ-редакторів зараз є найсильнішою

Якщо дивитися практично, логіка зараз проста: Runway закриває основний обсяг роботи, Veo 3.1 дає дуже сильний короткий вертикальний результат, а Sora 2 підключається тоді, коли потрібен максимально дорогий візуальний кадр.

Такий підхід виглядає найбільш раціональним і з погляду бюджету, і з погляду часу. Ти не переплачуєш за постійне використання складної моделі там, де достатньо швидшого інструмента, але водночас залишаєш собі доступ до сильнішого візуального рівня під конкретні задачі.

Фінальний висновок

У 2026 році найсильніше працює не ставка на одну AI-модель, а грамотна комбінація кількох інструментів під різні типи задач. Runway сьогодні реально може бути основною робочою базою, Sora 2 — інструментом для сильних візуальних акцентів, а Veo 3.1 — тим самим швидким рішенням для короткого контенту, коли важлива чистота кадру й швидка генерація.

Фактично ці три платформи вже формують дуже сильне комбо для контент-мейкера, який хоче працювати швидко, стабільно і без постійного відчуття, що якась задача технічно недоступна. Ну а якщо вдасться ще й без зайвих труднощів дістати стабільний доступ до Veo 3.1, то твій AI-відеостек у 2026 році вже виглядатиме майже максимально сильним.

Світ AI-відео змінюється швидше, ніж ми встигаємо дорендерити черговий кліп, тому зараз важливо не просто натискати кнопки, а розуміти логіку кожного інструмента. Якщо ти хочеш перестати гратися з промптами й почати створювати професійний контент на рівні топових студій, запрошую тебе на курс «AI Video Creator». Приєднуйся, щоб опанувати повний цикл продакшну та перетворити нейромережі на свій головний конкурентний актив.

FAQ’s

Чи можна в Sora 2, Veo 3 або Runway отримати одного й того самого персонажа в різних сценах?

Так, у 2026 році це головний тренд. Найкраще з цим справляється Runway Gen-4.5 завдяки функції Consistent Characters та Sora 2 (через режим Cameos). Ти завантажуєш кілька фото або коротке відео з людиною, і нейронка «запам’ятовує» її риси. Veo 3 також це вміє, але там це працює через систему «інгредієнтів» (референсів), що більше підходить для рекламних об’єктів, ніж для складних емоцій обличчя.

Яка модель найкраще підходить саме для української мови в озвучці та lip-sync?

Тут лідирує Sora 2. OpenAI інтегрували свої останні напрацювання з Whisper та GPT-4o, тому Sora найкраще розуміє українську фонетику і дуже точно синхронізує рухи губ персонажа. Runway теж підтримує українську, але інколи може виникати легкий «акцент» у рухах губ, що потребує додаткової корекції. Veo 3 наразі більше фокусується на англійській та великих світових мовах, хоча база розуміння української там є.

Кому належать авторські права на відео, згенероване нейромережею?

У 2026 році більшість платформ (включаючи Runway та Google) надає право на комерційне використання контенту за умови платної підписки. Проте Sora 2 маркує всі відео метаданими C2PA та водяними знаками, які неможливо видалити без порушення правил. В Україні та ЄС діють закони, що вимагають позначати AI-контент, тому ці інструменти інтегрують маркування автоматично.

Який АІ-інструмент найшвидший, якщо треба робити 10 Reels на день?

Безумовний фаворит за швидкістю — Runway Gen-4.5 у режимі Turbo. Він видає готовий результат за 10–20 секунд. Veo 3.1 теж має швидкий режим, але він часто обмежений роздільною здатністю 1080p. Sora 2 залишається найповільнішою: через складну фізику обчислень рендер одного якісного шоту може тривати кілька хвилин, що не зовсім підходить для конвеєрного виробництва.

Чи потрібно купувати підписки на Runway, Veo 3.1 та Sora 2 одночасно?

Немає сенсу оплачувати все одночасно: краще обрати одну базову платформу (наприклад, Runway для монтажу або Veo 3 для 4K) залежно від основних задач. Інші інструменти варто підключати точково через API або разові кредити лише тоді, коли потрібен специфічний “wow-ефект”, який не видає твоя основна нейромережа.

Глосарій

Генерація звуку (Audio Gen) — здатність нейромережі створювати нативний звук, ефекти (SFX) або мову, синхронізовану з відеорядом.

Глибина кадру (Depth of Field) — візуальний ефект, що створює об’єм у сцені за допомогою фокусування на об’єктах та розмиття фону.

Ключові кадри (Keyframes) — точки на часовій шкалі, за допомогою яких користувач Runway задає точні зміни параметрів камери або руху об’єктів.

Кредитна система — модель оплати в AI-сервісах, де користувач купує певну кількість балів (кредитів), які витрачаються залежно від тривалості та якості генерації.

Монтажний таймлайн — інтерфейс у Runway для професійної збірки ролика, де можна працювати з кількома шарами відео та аудіо одночасно.

Нативний звук — звук, який створюється нейромережею автоматично разом із відеорядом (наприклад, у Sora 2 чи Veo 3).

Промпт (Prompt) — текстовий запит або інструкція, за якою штучний інтелект створює відео.

Продакшн (Production) — процес створення відеоконтенту, що включає генерацію, монтаж, озвучку та фінальну обробку.

Стабільність персонажа (Consistent Characters) — технологія, що дозволяє зберігати однакову зовнішність героя в різних сценах та генераціях.

Фізика руху — здатність моделі (особливо Sora 2) реалістично відтворювати рух рідин, тканин та взаємодію фізичних об’єктів.

C2PA — стандарт цифрових метаданих, що вказує на походження контенту та підтверджує, що відео було створено за допомогою AI.

Ingredients to Video — функція Veo 3.1, що дозволяє використовувати зображення-референси для керування стилем та деталями майбутнього відео.

Lip Sync — технологія синхронізації рухів губ персонажа з вимовленим текстом або звуковою доріжкою.

Motion Brush — інструмент у Runway для «малювання» руху, що дозволяє вказувати нейромережі, які саме області кадру мають рухатися.

Mobile-first контент — професійний термін, який вказує на те, що відео від початку створювалося під екрани смартфонів, а не просто було обрізане.