Полный гайд по AI-агентам: чем отличаются от чат-ботов, как выбрать между Claude и ChatGPT, как написать промпт и запустить первого агента уже сегодня

Честное сравнение AI-видеомоделей: Sora, Veo или Runway, какой инструмент выбрать украинскому контент-мейкеру в 2026 году

Sora 2, Veo 3 или Runway, что на самом деле поможет тебе создавать кинематографический контент без бюджета голливудской студии? Сравниваем не только картинку, но и стоимость, стабильность генерации и удобство монтажа для регулярного создания видеоконтента.

Сегодня на рынке уже существуют десятки AI-инструментов для генерации видео. Но если посмотреть на модели, которые чаще всего обсуждают профессиональные креаторы, то на первых позициях стабильно остаются Sora 2, Veo 3 и Runway — именно они сейчас задают темп в сегменте AI-видео.

Оплачивать все платформы одновременно только для того, чтобы они пылились в закладках браузера по принципу «вдруг пригодятся», для большинства контент-мейкеров просто невыгодно. Так какая из моделей: Sora 2, Veo 3 или Runway — действительно может стать твоей «рабочей лошадкой» в 2026 году?

В этой статье разберем, что каждая модель делает лучше всего, сколько реально стоит работа с ней, где ты получаешь больше контроля над кадром, а где — более быстрый результат для ежедневного контента. Отдельно посмотрим, какой AI-видеостек сегодня выглядит наиболее рациональным именно для украинского контент-мейкера.

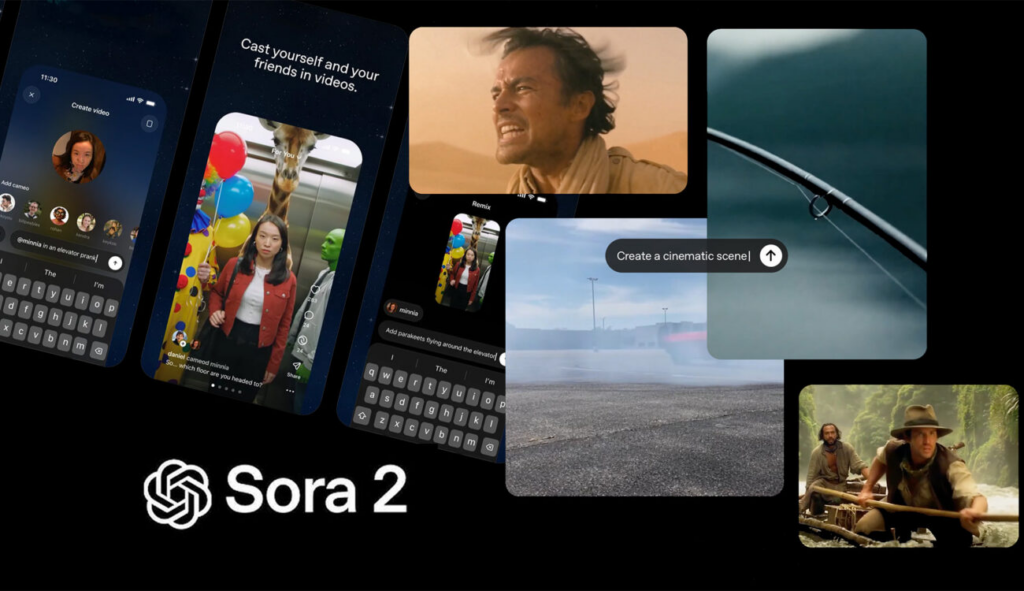

Sora 2: почему именно эта модель до сих пор считается эталоном AI-видео

Когда в AI-видео говорят о максимально реалистичном результате, первым почти всегда упоминают OpenAI Sora 2. Именно эта модель стала ориентиром для рынка после того, как показала сложные сцены с убедительной физикой движения, глубиной кадра и поведением объектов, напоминающим работу реальной камеры, а не просто анимацию.

На практике Sora 2 сильна там, где нужно создать видео, которое выглядит не как AI-эксперимент, а как короткий фрагмент рекламного ролика или трейлера. Модель хорошо работает со светом, перспективой, движением тканей, жидкостей и сложным взаимодействием нескольких объектов в кадре. Именно поэтому ее часто называют ближайшей к кинематографическому уровню среди доступных AI-видеорешений.

Что Sora 2 сегодня умеет лучше всего

Самая сильная сторона Sora — способность держать сложную сцену без резких визуальных сбоев. Если в prompt задать несколько элементов одновременно — например, движение человека, изменение освещения и перемещение камеры — модель в большинстве случаев сохраняет логику пространства. К сильным сторонам Sora 2 также относятся:

- реалистичная физика движения;

- плавные кинематографические переходы;

- более стабильное освещение в многослойных сценах;

- более точная глубина пространства;

- нативный звук в новых режимах генерации.

Отдельная функция, которая привлекла много внимания, — Characters. Она позволяет использовать одного персонажа в нескольких сценах с сохранением внешности и пластики, что особенно важно для рекламного или сюжетного контента.

Что важно знать перед реальной работой с Sora 2

Несмотря на впечатляющие результаты, Sora пока не выглядит как простой инструмент для повседневного использования. Даже в 2026 году OpenAI держит Sora 2 за высоким забором подписок (Plus/Pro) или через приглашения для «избранных» создателей.

Есть и технические рамки: большинство генераций работает в пределах 15 секунд (для премиум-подписки — 25 секунд). А это значит, что более длинный ролик приходится собирать из нескольких отдельных сцен. Для украинского пользователя отдельным вопросом остается и практическая сторона: оплата, стабильный доступ и прогнозируемость расходов пока выглядят более сложными, чем в более открытых платформах.

Где Sora 2 имеет ограничения

Несмотря на очень сильную картинку, Sora пока не дает такого production-комфорта, как браузерные AI-студии. После генерации сцену все равно часто приходится переносить в другой редактор для монтажа, титров, переходов и финальной сборки.

Также модель остается одной из наиболее юридически контролируемых. В видео добавляются watermark, C2PA-метаданные и дополнительные механизмы обнаружения AI-контента.

Для каких задач Sora 2 действительно оправдана

Sora сегодня — это скорее инструмент для точечного wow-эффекта, чем для ежедневного массового продакшена. Sora имеет смысл там, где нужен не большой объем, а сильный единичный результат:

- брендовая презентация;

- короткий рекламный ролик;

- трейлер;

- визуальный концепт для клиента;

- имиджевый контент.

Именно поэтому после первого знакомства с Sora многие креаторы переходят к другому вопросу: какая модель дает более практичный результат там, где контент нужно выпускать регулярно. И здесь логично перейти к Veo 3, которая сейчас очень быстро усиливает свои позиции именно в вертикальном видео.

Кстати, именно этот переход от «красивых картинок» к построению реальной системы работы мы подробно разбираем на курсе «AI Video Creator». Это кратчайший путь к пониманию того, как объединять различные сервисы в единый рабочий процесс, чтобы создавать контент быстрее и качественнее. Если чувствуешь, что готов превратить нейронки в свою полноценную видеостудию — присоединяйся.

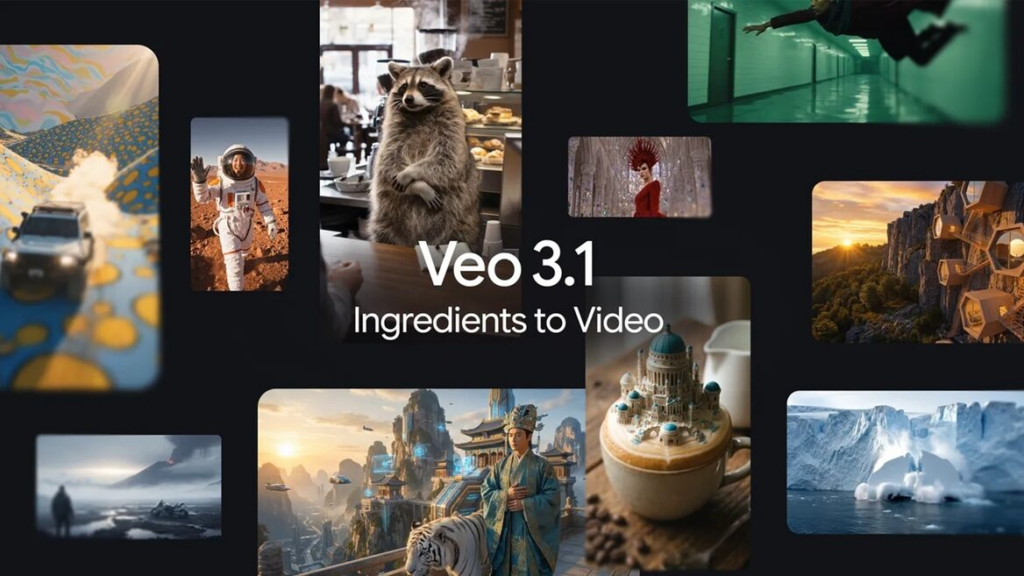

Veo 3.1: почему именно эта модель быстро стала фаворитом для вертикального видео

Если Sora 2 ассоциируется прежде всего с кинематографической сложностью кадра, то Veo 3.1 от Google быстро заняла другую сильную позицию — модель, которая очень хорошо понимает логику современного короткого видео для смартфона. Именно поэтому ее особенно активно тестируют те, кто работает с Shorts, Reels и вертикальными форматами, где важна не только эстетика, но и техническая чистота кадра.

В отличие от некоторых конкурентов, которые иногда дают эффектный, но менее предсказуемый результат, Veo 3.1 часто ведет себя как более «послушный» инструмент. Она точнее держит композицию, стабильнее выполняет заданное движение камеры и реже меняет логику сцены без причины. Именно эта предсказуемость сделала ее одной из самых сильных моделей для быстрого production-контента.

Что Veo 3.1 сегодня умеет лучше всего

Veo наиболее силен в коротких динамичных сценах, где важна чистота движения и точное выполнение визуальной логики. К сильным сторонам Veo 3.1 относятся:

- стабильная генерация вертикального формата 9:16;

- качественное движение камеры без резких сбоев сцены;

- хорошее соответствие деталям prompt;

- поддержка 1080p, 4K и до 60 fps в доступных режимах;

- нативный звук с фоновыми эффектами и голосом;

Отдельно стоит выделить функцию Ingredients to Video: модель позволяет использовать до четырех референсных изображений, чтобы лучше сохранить внешний вид персонажа, стиль окружения или отдельные детали сцены. Это особенно полезно, когда нужно получить серию визуально связанных кадров, а не один случайный результат.

Одной из причин, по которой Veo 3.1 быстро привлекла внимание креаторов, стала ее предсказуемость в работе. Если промпт сформулирован четко, модель чаще уже с первых генераций дает сцену, которая сохраняет нужную композицию, атмосферу и движение без резких визуальных сбоев.

В реальной работе это особенно ощущается, когда нужно быстро получить несколько вариантов одного кадра, протестировать различные подачи сюжета или подготовить серию коротких сцен для дальнейшего монтажа. Именно поэтому Veo 3.1 сейчас часто используют там, где важна не только качество отдельного кадра, но и скорость получения стабильного результата.

Если ты хочешь узнать, как выжать максимум из отснятого материала с помощью обычного смартфона, обязательно прочитай статью «Лучшие техники монтажа 2026: как сделать профессиональное видео на обычном телефоне». Там разобраны фишки, которые помогут твоему контенту выглядеть дорого даже без профессиональной камеры и сложного оборудования.

Что важно знать перед реальной работой с Veo 3.1

Одна из сильных сторон Veo — интеграция в экосистему Google. Удобнее всего модель работает через Google Gemini Advanced, Vertex AI или инструменты внутри YouTube, где уже тестируются функции генерации коротких фонов и коротких AI-вставок для видео.

Базовая длина генерации обычно составляет до 8–10 секунд, но модель поддерживает Scene Extension, что позволяет постепенно достраивать сцену без резкого разрыва между фрагментами. Для быстрых тестов также используется режим Veo Fast, который заметно сокращает время ожидания и удобен для A/B-проверки идей.

Еще один практический плюс — Veo хорошо работает в тех случаях, когда нужно быстро адаптировать одну идею под несколько форматов. Например, проверить, как одна сцена будет выглядеть в разных подачах или в другом ритме движения.

Где Veo 3.1 имеет ограничения

Несмотря на сильный результат, Veo пока не дает полной production-среды. После генерации сцены ее обычно все равно нужно переносить в отдельный редактор для монтажа, титров и сборки полноценного ролика. Для более длинных композиционных видео несколько генераций приходится комбинировать вручную, а при сложных многослойных сценах модель иногда уступает Sora в глубине физики движения.

Для каких задач Veo 3.1 действительно оправдана

Veo особенно хорошо подходит там, где нужно регулярно создавать качественный вертикальный контент без длительного цикла доработки:

- короткие видео для соцсетей;

- рекламные вертикальные вставки;

- мобильные product-shot сцены;

- тестирование creative-гипотез;

- быстрые видеофрагменты для YouTube Shorts.

Если коротко, Veo 3.1 сегодня выглядит как один из самых сильных вариантов для тех, кто хочет получить качественную картинку, которая не теряет чистоты даже при просмотре на большом экране. После этого логично перейти к модели, которая часто выигрывает не отдельным кадром, а именно удобством полного ежедневного workflow — Runway.

Runway Gen-4.5: главный хаб для ежедневной работы контент-мейкера

Если Sora 2 сегодня ассоциируется с максимально кинематографической картинкой, а Veo 3.1 — с точным вертикальным видео под эгидой Google, то Runway в 2026 году чаще всего воспринимают как практический центр ежедневного production-процесса. Причина проста: Runway давно вышел за пределы простой кнопки «генерировать видео» и фактически превратился в полноценную браузерную AI-студию, где ты не просто получаешь файл, а управляешь каждым пикселем на профессиональном уровне.

Для контент-мейкера это важно не только из-за количества функций, но и из-за самого подхода к работе: одна платформа позволяет пройти путь от первого промпта до почти готового ролика без постоянного перехода между разными сервисами. Именно поэтому Runway сегодня часто выбирают не для одного эффектного кадра, а как основной рабочий инструмент в регулярном продакшене.

Что Runway сегодня умеет лучше всего

Самая сильная сторона Runway — это сочетание генерации и детального редактирования в одном месте. Платформа позволяет работать не только с текстом (text-to-video) или изображениями (image-to-video), но и вносить точечные изменения в уже созданный материал с помощью инструментов, которые еще недавно ассоциировались только с профессиональным монтажным софтом. К сильным сторонам Runway относятся:

- Multi-shot Editing для редактирования серии сцен;

- Consistent Characters для стабильности персонажа между кадрами;

- Motion Brush 2.0 для управления движением отдельных зон кадра;

- Keyframes для точного контроля камеры;

- Motion Tracking для работы с движущимися объектами;

- полноценное редактирование на таймлайне.

Отдельное преимущество Gen-4.5 — возможность работать не с одним отдельным кадром, а с последовательностью сцен. Если нужно, чтобы персонаж оставался узнаваемым в нескольких разных локациях, Runway лучше большинства моделей сохраняет внешность, одежду и общую стилистику героя.

Еще одна причина популярности платформы среди монтажеров — Motion Brush 2.0. Этот инструмент позволяет буквально выделить часть кадра (например, волосы, туман или отдельный предмет) и задать направление движения вручную. В сочетании с ключевыми кадрами это создает ощущение, будто камера управляется не алгоритмом, а человеком.

Что важно знать перед реальной работой с Runway

Runway работает по кредитной системе, и это одна из причин, почему платформу часто считают удобной для планирования бюджета. Базовый тариф Standard стоит примерно 12 долларов в месяц и дает 625 кредитов. В режиме Turbo этого хватает примерно на 125 секунд генерации, что для ежедневного тестирования идей выглядит достаточно практично.

Если требуется максимальное качество, используется режим Gen-4.5 Pro, где расходы уже выше: около 12 кредитов в секунду. Но даже в этом случае система остается предсказуемой: пользователь четко понимает, сколько стоит каждая итерация.

Для тех, кто работает в высоком темпе, Runway предлагает Unlimited-режимы. И именно это часто становится ключевым преимуществом: когда в production нужно сделать десятки вариантов одной сцены, возможность не считать каждую генерацию отдельно значительно упрощает работу.

Что еще усилило Runway в 2026 году

В новых версиях платформа заметно продвинулась в работе со звуком. Runway уже поддерживает генерацию диалогов, синхронизацию губ через Lip Sync и создание фоновых шумов через Text to SFX, когда звук добавляется прямо внутри проекта.

Это означает, что часть базового sound-design теперь можно сделать без перехода в отдельный аудиоредактор. Для короткого digital-контента это особенно полезно, так как один сервис закрывает еще один этап production-цикла.

Где Runway имеет ограничения

Несмотря на статус универсального AI-комбайна, Runway пока уступает Sora 2 в очень сложной физике сцены. Если в кадре одновременно взаимодействуют жидкость, ткань, пыль и несколько движущихся объектов, результат иногда выглядит менее естественно.

Еще одна техническая особенность — базовая генерация часто стартует с 1080p, а для большого экрана или рекламного показа приходится отдельно использовать upscale.

Для каких задач Runway действительно оправдан

Runway особенно хорошо работает там, где нужен стабильный production-ритм:

- серийное создание Reels и Shorts;

- рекламные ролики из нескольких AI-сцен;

- комбинирование AI-видео с реальными футажами;

- VFX-правки (замена фона, удаление объектов, добавление деталей);

- быстрое прототипирование для клиента.

Если коротко, Runway сегодня побеждает не одним случайным сильным кадром, а тем, что позволяет быстрее других платформ довести сырую идею до готового продукта. І саме після трьох окремих моделей виникає головне практичне питання:який AI-відеостек обрати українському контент-мейкеру.

Какой AI-видеостек сейчас работает лучше всего для украинского контент-мейкера

После тестирования нескольких сильных моделей становится понятно: в ежедневной работе одна платформа редко закрывает абсолютно все, но Runway сегодня реально берет на себя до 90% ежедневных задач контент-мейкера. Именно здесь удобнее всего быстро собрать сцену, поправить детали, добавить текст, подчистить артефакты и довести материал до готового результата без постоянного перехода между несколькими сервисами.

Для большинства рабочих сценариев этого уже достаточно: короткие ролики для соцсетей, рекламные вставки, серии одинаковых сцен, быстрые визуальные концепты для клиента или адаптация одного сюжета в несколько форматов. Именно поэтому Runway часто становится базой, а другие модели подключаются точечно — тогда, когда нужна конкретная сильная сторона, которой не хватает в основном рабочем процессе.

Что реально дает каждая модель в ежедневной работеі

| Сценарий | Sora 2 | Veo 3.1 | Runway Gen-4.5 |

| Кинематографический рекламный ролик | максимально сильная физика кадра, глубина сцены, реалистичный свет | качественный краткий результат, но более короткий формат | можно собрать ролик из нескольких сцен и сразу смонтировать |

| Вертикальные видео для соцсетей | сильный результат, но менее гибкий в рутине | один из самых сильных вариантов под 9:16 | удобно доводить до окончательного вида |

| Ежедневное производство контента | дорого для большого объема | хорошо для отдельных снимков | наиболее удобно для регулярной работы |

| Стабильность персонажа между сценами | Characters | image references | Consistent Characters |

| Нативный звук | сильный уровень | сильный уровень | уже работает, но не главное преимущество |

| Редактирование внутри платформы | ні | ні | так |

| Работа с несколькими сценами подряд | ограничено | частично | одна из самых сильных сторон |

| Стартовая цена входа | от ~$20 | от ~$19.99 | от ~$12 |

| Лучший сценарий использования | дорогой бренд-контент | короткий вертикальный контент | ежедневный продакшн |

Почему именно комбинация АИ-редакторов сейчас является самой сильной

Если смотреть практично, логика сейчас проста: Runway закрывает основной объем работы, Veo 3.1 дает очень сильный короткий вертикальный результат, а Sora 2 подключается тогда, когда нужен максимально дорогой визуальный кадр.

Такой подход выглядит наиболее рациональным и с точки зрения бюджета, и с точки зрения времени. Ты не переплачиваешь за постоянное использование сложной модели там, где достаточно более быстрого инструмента, но в то же время оставляешь себе доступ к более сильному визуальному уровню под конкретные задачи.

Заключительное заключение

В 2026 году сильнее всего работает не ставка на одну AI-модель, а грамотная комбинация нескольких инструментов под разные типы задач. Runway сегодня реально может быть основной рабочей базой, Sora 2 — инструментом для сильных визуальных акцентов, а Veo 3.1 — тем самым быстрым решением для короткого контента, когда важна чистота кадра и быстрая генерация.

Фактически эти три платформы уже формируют очень сильное комбо для контент-мейкера, который хочет работать быстро, стабильно и без постоянного ощущения, что какая-то задача технически недоступна. Ну а если удастся еще и без лишних трудностей получить стабильный доступ к Veo 3.1, то твой AI-видеостек в 2026 году уже будет выглядеть почти максимально сильным.

Мир AI-видео меняется быстрее, чем мы успеваем прорендерить очередной клип, поэтому сейчас важно не просто нажимать кнопки, а понимать логику каждого инструмента. Если ты хочешь перестать играть с промптами и начать создавать профессиональный контент на уровне топовых студий, приглашаю тебя на курс «AI Video Creator». Присоединяйся, чтобы освоить полный цикл продакшна и превратить нейросети в свой главный конкурентный актив.

Часто задаваемые вопросы

Можно ли в Sora 2, Veo 3 или Runway получить одного и того же персонажа в разных сценах?

Да, в 2026 году это главный тренд. Лучше всего с этим справляется Runway Gen-4.5 благодаря функции Consistent Characters и Sora 2 (через режим Cameos). Вы загружаете несколько фото или короткое видео с человеком, и нейронная сеть «запоминает» его черты. Veo 3 также это умеет, но там это работает через систему «ингредиентов» (референсов), что больше подходит для рекламных объектов, чем для сложных эмоций лица.

Какая модель лучше всего подходит именно для украинского языка в озвучке и lip-sync?

Здесь лидирует Sora 2. OpenAI интегрировали свои последние наработки с Whisper и GPT-4o, поэтому Sora лучше всего понимает украинскую фонетику и очень точно синхронизирует движения губ персонажа. Runway тоже поддерживает украинский, но иногда может возникать легкий «акцент» в движениях губ, что требует дополнительной коррекции. Veo 3 пока больше фокусируется на английском и крупных мировых языках, хотя база понимания украинского там есть.

Кому принадлежат авторские права на видео, сгенерированное нейросетью?

В 2026 году большинство платформ (включая Runway и Google) предоставляет право на коммерческое использование контента при условии платной подписки. Однако Sora 2 маркирует все видео метаданными C2PA и водяными знаками, которые невозможно удалить без нарушения правил. В Украине и ЕС действуют законы, требующие маркировать AI-контент, поэтому эти инструменты интегрируют маркировку автоматически.

Какой ИИ-инструмент самый быстрый, если нужно делать 10 Reels в день?

Безусловный фаворит по скорости — Runway Gen-4.5 в режиме Turbo. Он выдает готовый результат за 10–20 секунд. Veo 3.1 тоже имеет быстрый режим, но он часто ограничен разрешением 1080p. Sora 2 остается самой медленной: из-за сложной физики вычислений рендер одного качественного кадра может длиться несколько минут, что не совсем подходит для конвейерного производства.

Нужно ли покупать подписки на Runway, Veo 3.1 и Sora 2 одновременно?

Нет смысла оплачивать все одновременно: лучше выбрать одну базовую платформу (например, Runway для монтажа или Veo 3 для 4K) в зависимости от основных задач. Другие инструменты стоит подключать точечно через API или разовые кредиты только тогда, когда нужен специфический «wow-эффект», который не дает твоя основная нейросеть.

Глоссарий

Генерация звука (Audio Gen) — способность нейросети создавать нативный звук, эффекты (SFX) или речь, синхронизированную с видеорядом.

Глубина кадра (Depth of Field) — визуальный эффект, создающий объем в сцене с помощью фокусировки на объектах и размытия фона.

Ключевые кадры (Keyframes) — точки на временной шкале, с помощью которых пользователь Runway задает точные изменения параметров камеры или движения объектов.

Кредитная система — модель оплаты в AI-сервисах, где пользователь покупает определенное количество баллов (кредитов), которые расходуются в зависимости от продолжительности и качества генерации.

Монтажная временная шкала — интерфейс в Runway для профессиональной сборки ролика, где можно работать с несколькими слоями видео и аудио одновременно.

Нативный звук — звук, который создается нейросетью автоматически вместе с видеорядом (например, в Sora 2 или Veo 3).

Промпт (Prompt) — текстовый запрос или инструкция, по которой искусственный интеллект создает видео.

Продакшн (Production) — процесс создания видеоконтента, включающий генерацию, монтаж, озвучку и финальную обработку.

Стабильность персонажа (Consistent Characters) — технология, позволяющая сохранять одинаковую внешность героя в разных сценах и генерациях.

Физика движения — способность модели (особенно Sora 2) реалистично воспроизводить движение жидкостей, тканей и взаимодействие физических объектов.

C2PA — стандарт цифровых метаданных, указывающий на происхождение контента и подтверждающий, что видео было создано с помощью AI.

Ingredients to Video — функция Veo 3.1, позволяющая использовать изображения-референсы для управления стилем и деталями будущего видео.

Lip Sync — технология синхронизации движений губ персонажа с произносимым текстом или звуковой дорожкой.

Motion Brush — инструмент в Runway для «рисования» движения, позволяющий указывать нейросети, какие именно области кадра должны двигаться.

Mobile-first контент — профессиональный термин, который указывает на то, что видео изначально создавалось под экраны смартфонов, а не просто было обрезано.